【www.zhangdahai.com--其他范文】

朱 璐,陈世平

(上海理工大学 光电信息与计算机工程学院,上海 200093)

文本情感分析是自然语言处理领域的一项重要研究内容,其目的是从文本数据中识别和提取评论者的主观信息.特别是在当下信息爆炸时代,人们可以随时在微博、知乎等社交媒体平台进行评论和情感表达,进而产生了大量带有情感倾向的文本数据[1].通过对这些社交媒体的文本数据进行分析,可以更好的了解用户的想法和意见,因此对社交媒体中数量庞大的数据信息进行情感分析成为近年来研究的热点.

目前文本情感分析方法主要分为3类:基于情感词典的文本情感分析方法、基于机器学习的文本情感分析方法和基于深度学习的文本情感分析方法.

基于情感词典的方法是利用词典对情感词进行识别,获取情感值,然后根据计算规则,得出分类结果.Zhang等[2]通过附加程度副词、网络词汇等扩展情感词典,取得了较好的分类效果.Wu[3]等人在目标词提取的基础上,提出一种针对特定目标自动构建情感词典的方法.基于情感词典的方法易于实现,但在不同领域存在着明显的局限性,分析的质量在很大程度上取决于情感词典,大部分情感词典存在情感词覆盖面不够、领域词匮乏等问题.

朴素贝叶斯、SVM、最大熵、随机森林和条件随机场模型等[4,5]是被常用于文本情感分类的机器学习方法.Yang等[6]设计了一种分段级联合话题-情感模型(STSM)来捕获话题-情感的相关性,并获得针对细粒度的情感分类.Fu[7]等人提出一种AL-SSVAE的半监督情感分类模型,该模型能够更准确地捕捉给定对象的语义和情感,在情感分类任务中取得了较好的性能.基于机器学习的方法虽然可以自动提取特征,但往往依赖于人工选择特征,而且性能也达到瓶颈.

近年来,许多学者将深度学习方法引入到文本情感分析中,并取得了良好的效果.基于深度学习的方法在神经网络模型中自动提取特征,并从自身的误差[8,9]中学习.Word2vec是2013年谷歌提出的词向量工具集,简单有效地解决了词向量表示问题[10],但其获取的分布式词向量未包含情感信息.Kim[11]首先将词向量输入不同尺寸的卷积核进行卷积实现情感分类,取得了不错的分类效果.Li[12]等人利用卷积神经网络对微博用户评论数据集进行情感分类,取得了较好效果.Miao[13]等人提出利用CNN提取文本的局部特征,然后通过BiGRU提取文本的序列特征,再通过两个单向GRU层进一步减少文本特征,最后在分类器得到情感分类.赵亚欧[14]等人针对单一词向量问题,提出利用ELMo获得词向量,并通过多尺寸卷积神经网络实现文本情感分类.Zhang[15]等人提出的DSCNN通过长短期记忆网络处理预先训练的词向量,然后使用卷积操作提取特征以层次化地构建分类模型,但网络模型输入单一,未能获得有效的文本情感特征表示.

同时,越来越多的学者也将注意力机制融合到深度学习模型当中,通过获取更多隐含的文本特征取得更好的分类效果.Wang Z[16]提出利用KNN计算注意力权值增强模型的分类效果.Zhu[17]等人利用BiLSTM提取包含上下文信息的文本特征,并利用自注意机制对提取的特征进行处理,再利用多尺寸卷积神经网络进行局部特征提取获得更高层次的抽象表示,提高了分类的准确性.CRAN[18]利用卷积操作捕获注意力,将RNN与注意力相结合实现文本分类,但未充分考虑文本实例对象对分类结果的影响.关鹏飞[19]等人提出利用注意力机制直接学习文本特征的权重分布,通过与BiLSTM并行的方式在微博数据集上取得了较好的分类效果,但未能充分利用文本实例信息,忽略了与待分类文本关联性更强更有意义的文本特征.

整体上来看,目前大量模型采用的分布式词向量不包含关于词的情感信息及其对分类的贡献,导致模型输入单一,无法关注重点情感特征信息;

大量研究也未充分利用文本实例对象信息,未能利用文本间的相似性关系,而文本特征具有依赖性,相同话题下的数据集中则存在更多相似性特征.

针对上述问题,本文提出一种融合情感增强与注意力的文本情感分析模型(TKACNN,Convolutional neural network based on TF-IDF and KNN-Attention),贡献有以下3个方面:

1)本文通过构建关键因子θ,将文本中的情感信息即情感词和程度副词融入到TF-IDF方法中以构建加权词向量,关注重点情感信息,实现了情感信息上的增强.

2)本文基于具有空间属性权重的加权欧式距离,对最近邻算法进行改进,以获取更优衡量距离.然后利用最近邻改进算法获取相似文本和其标签向量,以此为基础构建注意力机制.通过选取与待分类文本关联性更强更有意义的文本特征,并结合标签向量实现了多维特征的提取并有效增强了卷积神经网络的分类能力.

3)最后将注意力机制与多尺寸卷积神经网络结合,实现局部和全局特征的提取,有效的利用实例信息.实验表明本模型分类效果更优,为今后工作提供了新的解决思路.

在文本情感分析任务中,带有情感信息的词是极性划分的重要因素.目前,大量研究采用的输入模型单一,所以本文利用TF-IDF构造包含有情感信息加权的词向量,实现词向量的情感增强,以增强神经网络对文本情感信息的学习.

3.1 情感信息特征构建

为考虑情感词和程度副词对文本情感分类的影响程度,本文通过匹配情感词典来确定词语是否包含情感词和程度词,通过桥梁关键因子融入到TF-IDF方法计算每个词的权重,权重值的大小对分类结果会产生影响,需要能排除冗余噪声,又能凸显出更有意义的特征.

目前,Hownet、《国立台湾大学词典》和《清华大学汉语褒贬词典》是文本情感分析中常用的情感词典.如果词典中的词数过大,则会包含大量的情感信息较低的词.如果词典中的词数太少,就会忽略文本中大量的情感信息词,降低分类的准确性.本文采用Hownet,该词典中含有中等数量的具有高度情感信息的词,如表1-表3所示.

表1 正情感词信息

表2 负情感词信息

表3 程度词信息

文本与Hownet词典匹配完成后,为出现的情感词和程度词的赋予相应的权重,如式(1)所示,s为是否包含情感信息的权值,θ为关键影响因子且θ>1.

(1)

3.2 加权词向量

首先本文利用word2vec[10]工具对数据集进行处理得到词向量,则文本可表示为Vi={vi1,vi2,…,vil}.其中l是最大词语数,i是训练文本中第i个文本,d表示词语特征维数,则文本可以表示为l×d维的矩阵向量.然后Vi作为输入传入多尺寸卷积神经网络模型.训练集为:N={V1,V2,…,Vm},其对应的类别标签是:y={y1,y2,…,ym}.

TF-IDF是一种常用的权值计算方法,计算公式见式(4):

(2)

(3)

(4)

其中tf(ti,d)表示特征词ti在文档d中的频数,M表示文档d中词的总数.idf(ti)表示逆文档频率,nti表示包含特征词ti的文本数.

融入关键因子的权重函数:首先根据式(4),获取特征词的tf-idf,再融合关键因子对权重重建即wi,如式(5)所示:

wi=w′(ti,d)·s

(5)

其中ti为单词,w′(ti,d)为公式(4)计算出的特征单词的tf-idf值,wi为权重.

最后通过word2vec训练得到分布式词向量,构建加权词向量V′作为输入模型传入多通道卷积神经网络,如式(6)所示:

(6)

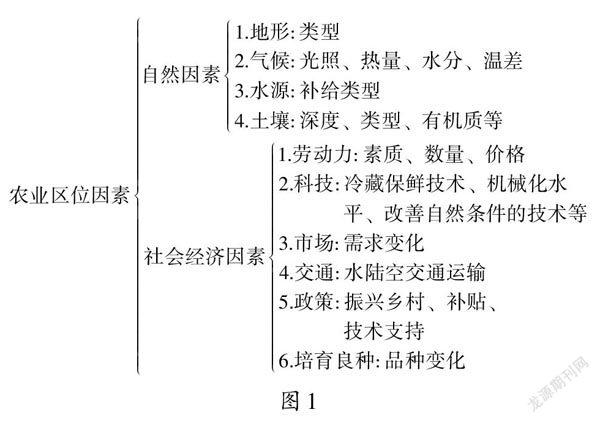

融合情感增强与注意力的多尺寸卷积神经网络文本情感分析模型(如图1所示).首先根据第3节,通过关键因子将情感词和程度副词贡献度融入TF-IDF方法重建包含情感信息加权的词向量,作为输入模型传入卷积神经网络.然后依据改进后的KNN在已知标签的训练集中获取与待分类文本关联性更强、相似度更高的文本及其标签向量构建注意力机制,对文本特征进行权重更新后至全连接层进行训练,进一步提升文本情感分类的性能.最后通过softmax完成文本情感分类任务.

图1 基于情感增强与注意力的多尺寸卷积神经网络

4.1 输入层

第3节得到的词向量V′作为神经网络的输入分类模型.

4.2 卷积层

卷积层的主要功能是提取输入矩阵最重要的局部特征.将训练好的l×d维文本向量作为模型的输入,使用多尺寸的卷积核对其进行卷积操作,获取多维特征的提取.本文使用的多尺寸卷积核高度为3、4、5,即尺寸为h×d.设置滑动步长为1,则滑动窗口可表示为{S1:h,S2:h+1,…,Sl-h+1:l},对于输入矩阵Vi={vi1,vi2,…,vil},卷积运算为:

(7)

式(7)中Wh代表权重矩阵,Wh∈Rh*d,t是滑动窗口的参数且t∈l,b∈R为偏置量,⊗为卷积计算.激活函数有tanh、sigmoid和Relu等,本文的激活函数f(x)采用Relu函数进行学习优化,卷积运算完成后,特征向量矩阵C表示为:

(8)

为了捕捉不同文本层的高级特征,进一步使用了多个不同维度的卷积核,并对卷积得到的多个特征矩阵进行汇聚和压缩,提取主要特征.

4.3 池化层

经过卷积操作之后,会有一些冗余特征,池化层的对文本特征进一步压缩,捕获更有意义的特征.池操作通常分为平均池和最大池.对于文本情感分析,影响最大的通常是句子中的几个单词或短语,所以我们使用Max-pooling来提取最有意义的特征,每个尺寸的卷积核个数为128.

高度h为3、4、5卷积后得到的特征图为:

C3=[C31,C32,…,C3128,max]

C4=[C41,C42,…,C4128,max]

C5=[C51,C52,…,C5128,max]

(9)

把经过池化后得到的特征矩阵进行拼接可以得到:

C′=[C3,C4,C5]

(10)

将文本矩阵C′作为全连接层的输入.

4.4 注意力机制

TKACNN 模型利用 Attention 机制对语义特征进行权重学习,从多维特征矩阵学习更多更全面的信息,再经过softmax的分类器完成分类.

4.4.1 基于加权欧式距离的最近邻改进算法

最近邻算法通常采用欧氏距离来计算文本之间的相似度,本文使用加权欧氏距离计算相似度如式(11)所示:

(11)

公式(11)中Vt为待测文本,Vi为训练文本,wji表示文本在不同特征值的权重.结合局部与空间属性对特征值的影响[20],得到加权欧氏距离.基于欧氏距离结合特征因素差异的空间属性权重的加权计算公式如式(12)所示,表示有关测试点在整个数据集和训练集中的相对位置影响.

(12)

具有空间属性权重的加权欧氏距离计算文本相似度,不但减少差异性了的影响,而且能获取更优的衡量距离.在训练集中找到与待分类文本Xi最相似的K个文本:{V1,V2,…,Vk},对应的类别标签为:{y1,y2,…,yk}.

4.4.2 最近邻注意力机制

考虑文本间关联性对分类效果的影响,本文对3.4.1中得到的矩阵进行注意力构建,捕获更多隐含的更有有意义的特征.最后将注意力矩阵融合,一起输入至全连接层进行训练(如图1所示).

通过加权欧氏距离的最近邻算法得到每个文本最相似的K个文本:{V,V2,…,Vk},其对应的类别标签为:{y1,y2,…,yk}.每个文本与其K个文本的相似度计算公式如下[16]:

Qj=sim(V,Vj)

(13)

Q={Q1,Q2,…,Qk}

(14)

其中j∈{1,2,3,…,k},Qj表示待分类文本V与K个最相似文本的相似度,且组成相似度权重集Q.采用相似度权重集Q对改进的KNN算法得到的文本进行加权,利用公式(14)得到相似特征矩阵V′如公式(15)所示:

(15)

同时为了考虑文本矩阵V′对输入文本的影响,计算输入文本V对相似特征矩阵V′每一维特征的相似度,那么注意力的计算如公式(16)所示:

(16)

采用相似度权重集Q对文本标签y加权得到加权标签y′,计算公式如式(17)所示:

(17)

两个注意力矩阵为:T=VA·W0和T′=y′·W1(W0∈Rs*d,W1∈Rs*d).将T与T′进行拼接输入至全连接层训练.结合基于神经网络和基于实例的特征学习,可以有效提高分类能力.

4.5 全连接层

全连接层将有用的信息进一步整合提取和保留,计算如式(18)所示,其中W为权重,b为偏置量,采用Relu作为激活函数:

C″=f(WC′+b)

(18)

4.6 输出层

通过sortmax分类器得到分类结果,计算如式(19)所示,激活函数采用sigmod:

(19)

本文模型定义的交叉熵损失函数如式(20)所示,采用的激活函数为Adam[21]:

(20)

5.1 实验环境

实验环境及配置如表4所示.

表4 实验环境

5.2 数据集及评价指标

本文针对评论数据集进行实验,数据集采用公开数据集中文计算会议测评的微博情感数据集NLPCC2014和英文电影评论数据集MR,实验采用10折交叉验证的方法对NLPCC2014和MR数据集进行验证,以降低随机性对分类效果的影响.数据分类结果为两类:正类和负类.表5、表6分别是NLPCC2014和MR数据集统计信息和数据集样例信息.

表5 ChnSentiCorp数据集的统计信息

表6 NLPCC2014和MR数据集样例

通过准确率(Accuracy)、召回率(Recall)、精确率(Precision)、F1作为本文的评估指标以验证模型的有效性,定义如下:

(21)

(22)

(23)

(24)

5.3 实验参数设置

θ是情绪信息对情绪分类任务贡献的度量.θ值过小,不能充分反映情感词与非情感词的差异,降低了情感分类的效果;

如果θ过大,则会过度衡量情感信息的贡献,降低情感分类的准确性.图2为不同值下模型的分类效果.

图2 θ取值实验结果

由图2可以看出,随着θ的增大,F1先增大后减小.当θ为2、3、4时,将情感信息对模型的贡献纳入词向量的权值中,使F1高于基值,同时关键影响因子θ分别为2、3时,F1得分最高,达到最大值80.31%、82.21%.当θ大于5时,情感信息与非情感信息的权重相差过大,导致F1低于基值.

实验参数设置如表7所示.

表7 参数设置

5.4 实验结果与分析

对本文提出的融合情感增强和注意力的文本情感分析模型(TKACNN)进行试验,并且为了证明本文模型的有效性,分别与不同基准模型进行对比.针对NLPCC2014数据集,对比的基准模型为CNN[11]、MSCNN[14]、BiLSTM[19]、CNN-SVM[22];

针对MR数据集,对比的基准模型为CNN[11]、DSCNN[15]、CRAN[18]、CNN-BiGRU[23].

CNN是基于Kim提出的卷积神经网络分类模型.

MSCNN利用语言模型ELMo捕获网络输入,再通过多尺寸卷积神经网络得到分类结果.

BiLSTM将注意力机制与双向LSTM以并行方式融合的神经网络模型.

CNN-SVM利用CNN表示特征向量,并通过SVM进行情感分类.

DSCNN通过LSTM处理预先训练的单词嵌入,然后使用卷积运算符提取特征,层次化地构建文本表示.

CRAN通过卷积操作捕获注意力,将RNN与注意力相结合,对文本进行建模,最终实现文本分类.

CNN-BiGRU通过BiGRU得到语义分布,然后利用浅层词级CNN获得中间表示,并通过整合得到分类结果.

TK-CNN.采用传统欧氏距离的KNN算法和多尺寸卷积网络结合构建的情感增强分类模型.

TKACNN.本文提出的融合情感增强与注意力的文本情感分析模型.

1) 针对两个数据集与其他基准方法进行对比,在准确率方面(Accuracy) 本文模型和对比实验结果如表8、表9所示.

表8 5种算法在NLPCC2014数据集上的准确率对比实验结果

表9 5种算法在MR数据集上的准确率对比实验结果

由实验结果可以看出,相比较而言,本文模型在数据集NLPCC2014和MR上都表现出良好性能.在NLPCC2014微博数据集上的准确率,本文模型相比卷积神经网络方法提高了3.07%,相比MSCNN方法提高了1.99%,相比最好的基准模型BiLSTM提高了1.59%,相比于NLPCC2014_Task2最优实验结果[24]提高了8.85%;

在英文数据集MR上的准确率,本文模型相比卷积神经网络提高了1.52%,相比DSCNN模型提高了0.6%,相比最好的基准模型CRAN提高了0.1%.可以看出本文模型表现出优越的性能,这是因为本文模型考虑到在输入模型中融合情感信息,有效实现了词向量的情感增强,并且通过构建注意力机制获得更多隐含信息,更有效地利用文本实例信息,使得文本特征与类别更具相关性,从而获得的多维特征增强模了型的分类能力.

2)本文模型相比于TK-CNN模型在两个数据集上的准确率均有所提高,可以看出基于改进的加权最近邻算法比传统最近邻算法分类结果更好,这是因为本文模型利用空间属性对距离加权减少差异性的影响,得到更优的衡量距离.本文模型与TK-CNN在指标精确率、召回率、F1、准确率上的结果如表10所示.

表10 不同数据集上的实验结果

3)如图3所示,相比于K-CNN(在本文提出的模型基础上,不进行第2节的情感增强机制),本文模型在NLPCC2014微博数据集和英文数据集MR上的准确率均有所提高,说明通过本文的情感增强机制,可以增强神经网络对文本情感信息的学习,能有效增强分类结果的准确性.

图3 K-CNN、T-CNN、TKACNN实验结果

相比T-CNN(在本文提出的模型基础上,不进行第3节的注意力机制),本文模型在NLPCC2014微博数据集和英文数据集MR上的准确率也均有所提高,说明通过选取与待分类文本关联性更强更有意义的文本特征,可以从多维特征矩阵中获得更多隐含特征,加强了分类的准确性.

4)考虑注意力机制中的两个加权向量VA和y′对分类结果的影响,设置aCNN(加权向量VA)、bCNN(加权标签y′)对比实验进行验证.

由表11可以看出,3个实验结果都优于卷积神经网络,说明本文模型利用最近邻改进算法可以选取更有意义的文本特征,并结合标签向量加强了分类特征的准确性,并且将加权文本和加权标签结合来构建注意力机制效果最优,更能捕获文本间的依赖关系,证明了本文模型的可行性(如图4所示).

图4 aCNN、bCNN、TKACNN实验结果

表11 加权文本VA和加权标签y′对分类结果的影响

5)不同的K值对模型分类影响不同,考虑K值变化在NLPCC2014与MR数据集上的影响,设置K∈[1,20].

K值的变化会对分类结果产生影响,若值较小,会造成信息提取不充分,若值较大,会导致信息过大造成冗余.如图5所示,K取0时,在NLPCC2014微博数据集和英文数据集MR上的准确率分别为78.67%、80.97%.随着K值增加,在数据集上的准确率增高,在NLPCC2014微博数据集上,K=8时,准确率达到80.31%,在英文数据集MR上,K=13时,准确率达到82.10%.由图中的曲线可以看出,合适的K值可以提高模型的准确率,在一定条件下模型的准确率会随着K值的升高而提高,但超过某一数值之后,模型的准确率会随着K值的升高而降低,这是因为过多的冗余特征产生噪声干扰.

图5 NLPCC2014与MR实验结果

本文提出一种融合情感增强与注意力文本情感分析模型(TKACNN),通过实验表明本文模型相较于其他对比试验取得良好的分类效果,在准确率上超过已有的最好模型,性能表现更优,为今后的研究工作提出了新的思路.

首先本文在分布式词向量的基础上,将情感词和程度副词信息通过桥梁关键因子融入到TF-IDF重建权重,获得了具有情感信息的词向量表示,实现词向量的情感增强.然后本文构建了具有空间属性的加权欧式距离改进最近邻算法,在已知标签的训练集中找寻与待分类文本关联性更强、相似度更高的文本及其标签向量,以此为基础构建最近邻注意力机制对文本特征进行权重更新,充分利用对象实例信息,实现了多维特征的提取并有效增强了卷积神经网络的分类能力.最后将注意力机制与卷积神经网络结合实现了局部与全局特征的提取,完成分类.

今后的研究工作:本文提出的方法将情绪分为积极和消极两类,今后需进一步研究文本的情感更精细度的分类.

猜你喜欢 卷积向量神经网络 基于全卷积神经网络的猪背膘厚快速准确测定农业工程学报(2022年12期)2022-09-09基于神经网络的船舶电力系统故障诊断方法舰船科学技术(2022年11期)2022-07-15基于人工智能LSTM循环神经网络的学习成绩预测中国教育信息化·高教职教(2022年4期)2022-05-13向量的分解新高考·高一数学(2022年3期)2022-04-28基于图像处理与卷积神经网络的零件识别计算技术与自动化(2022年1期)2022-04-15MIV-PSO-BP神经网络用户热负荷预测煤气与热力(2022年2期)2022-03-09基于深度卷积网络与空洞卷积融合的人群计数上海师范大学学报·自然科学版(2019年5期)2019-12-13三次样条和二次删除相辅助的WASD神经网络与日本人口预测软件(2017年6期)2017-09-23卷积神经网络概述中国新通信(2017年9期)2017-05-27向量垂直在解析几何中的应用高中生学习·高三版(2016年9期)2016-05-14本文来源:http://www.zhangdahai.com/shiyongfanwen/qitafanwen/2023/0412/583390.html